3月4日研究人员通过融合混合现实和机器人技术来增强人机交互

在过去的几十年里,工程师们创造了具有越来越先进的功能和能力的设备。近年来大幅改进的设备能力被称为“空间计算”。

空间计算一词本质上是指计算机、机器人和其他电子设备“了解”其周围环境并创建其数字表示的能力。传感器和混合现实(MR)等尖端技术可以显着增强空间计算,从而创建复杂的传感和地图系统。

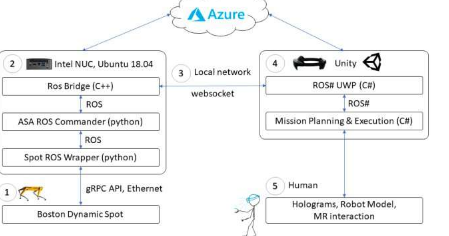

微软混合现实与人工智能实验室和苏黎世联邦理工学院的研究人员最近开发了一种新框架,将MR和机器人技术相结合,以增强空间计算应用。他们实施并测试了这个框架,该框架在arXiv上预先发表的一篇论文中介绍了一系列人机交互系统。

研究人员在论文中写道:“混合现实设备上的空间计算和以自我为中心的传感相结合,使他们能够捕捉和理解人类行为,并将这些行为转化为具有空间意义的行为,这为人类和机器人之间的协作提供了令人兴奋的新可能性。”“本文介绍了几个利用这些功能实现新型机器人用例的人机系统:检查任务规划、基于手势的控制和沉浸式远程操作。”

这组研究人员设计的基于MR和机器人技术的框架在三个具有不同功能的不同系统上实现。值得注意的是,所有这些系统都需要使用HoloLensMR耳机。

第一个系统旨在规划需要检查给定环境的机器人任务。从本质上讲,人类用户在他/她希望戴着HoloLens头戴设备检查的环境中移动,放置形状为定义机器人轨迹的航点的全息图。此外,用户可以突出显示希望机器人收集图像或数据的特定区域。这些信息经过处理和翻译,随后可用于指导机器人在检查环境时的运动和动作。

研究人员提出的第二个系统是一个允许人类用户更有效地与机器人交互的界面,例如,使用手势控制机器人的运动。此外,该系统还可以实现不同设备的共定位,包括MR耳机、智能手机和机器人。

“设备的共定位要求它们每个都能够将自己定位到一个共同的参考坐标系,”研究人员写道。“通过他们相对于这个公共坐标系的个人姿势,可以计算本地设备之间的相对变换,然后用于启用新的行为和设备之间的协作。”

为了对设备进行共定位,该团队引入了一个框架,可确保其系统中的所有设备共享其相对于彼此的位置和一个共同的参考地图。此外,用户可以使用HoloLens耳机向机器人发出导航指令,只需执行一系列直观的手势即可。

最后,第三个系统实现了身临其境的远程操作,这意味着用户可以在查看周围环境的同时远程控制机器人。在需要机器人在人类无法进入的环境中导航的情况下,该系统可能特别有价值。

研究人员解释说:“我们探索了用户对远程机器人的动作的投射,以及机器人对用户的空间感。”“我们考虑了几个层次的沉浸感,基于触摸和操纵机器人模型来控制它,以及成为机器人并将用户的动作直接映射到机器人的更高层次的沉浸感。”

在最初的测试中,JeffreyDelmerico和他在微软的同事提出的三个系统取得了非常有希望的结果,突出了使用MR来增强空间计算和人机交互的潜力。将来,这些系统可以在许多不同的环境中引入,使人类能够与机器人密切合作,有效地解决更广泛的复杂现实问题。

标签: